そこに存在する音

ハイパーリアリスティック・バイノーラルプロセッサー

「chi.binaural」(通称チバイノーラル)はモデリング・アルゴリズムを使用したバイノーラル・プロセッシング技術です。

バイノーラル・プロセッシングとは、通常の音源(バイノーラル録音でない)に対し、後処理でバイノーラル立体定位を付与する信号処理技術で、音楽制作の分野ではバイノーラル・パンニングなどとも呼ばれます。技術的には以前から専用ハードウェアやオーディオ・プラグインなどの形で存在しており、その多くは全天全周のHRTF(頭部伝達関数)をインパルス・レスポンスとして測定してデータベース化、リアルタイムのコンボリューション(畳み込み)を行うことで実現されます。現実の定位感のサンプリングとも言えるこの方式は一定のリアルな結果が得らる一方で、方位・距離の違いを無限に細かく測定するわけにはいかず、測定時のグリッド(数度〜10度単位程度)を補間で埋める必要があります。距離については音量のみで表現することがほとんどです。インパルス・レスポンスの測定は、スピーカーから発した音を人間やダミーヘッドの耳に仕込んだマイクで収録するという方法で行われるため、そこで音質的な劣化が生じる問題もあります。

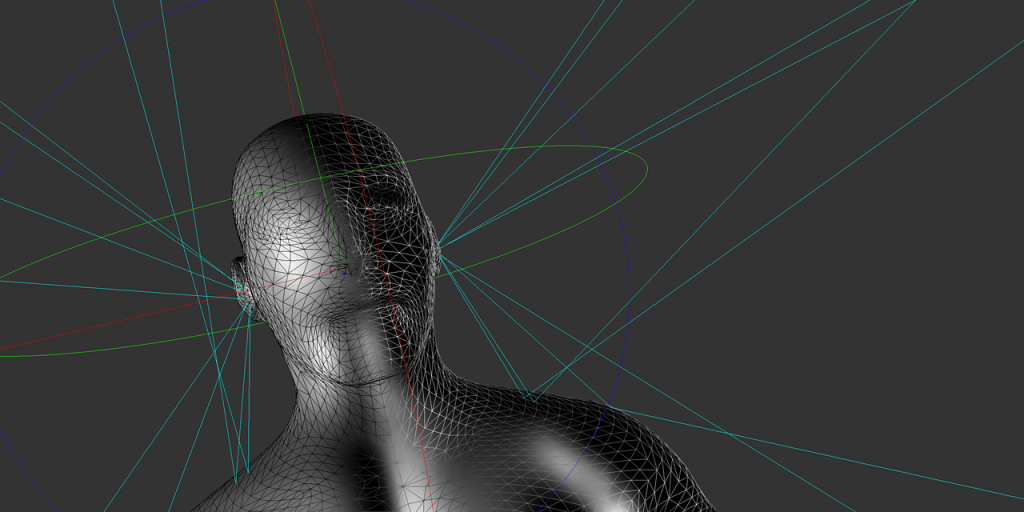

chi.binauralは、独自の研究に基づいたモデリング・アルゴリズム(HRTFデータベースを用いず、頭部や耳介の抽象化モデルをリアルタイム処理する)によってバイノーラル立体定位を実現します。そこに測定のためのスピーカーやマイクは介在せず、内部的な方位グリッドも存在しません。距離による微妙な音の変化や近接効果もシミュレートされ、リアルな距離表現が可能です。その結果生み出されるのは非常にスムーズかつクリアーな立体定位。目指したのは「そこに存在する音」、そして音楽家目線での「使える音」です。

chi-binauralは現在、Cycling’74 Maxのエクスターナル・オブジェクトとして試験実装されており、OpenGL(Jitter)互換の座標系、聴取者方位の回転をサポートし、自由度の高いリアルタイム処理が可能となっています。ジャイロ・センサーやモーション・キャプチャーによるヘッド・トラッキングと組みあわせることで、本格的な「音のVR/AR」も実現します。コンボリューションを行う方式と比較して低負荷で動作するのも特徴です。

chi-binauralは現在、Cycling’74 Maxのエクスターナル・オブジェクトとして試験実装されており、OpenGL(Jitter)互換の座標系、聴取者方位の回転をサポートし、自由度の高いリアルタイム処理が可能となっています。ジャイロ・センサーやモーション・キャプチャーによるヘッド・トラッキングと組みあわせることで、本格的な「音のVR/AR」も実現します。コンボリューションを行う方式と比較して低負荷で動作するのも特徴です。

使用事例

Rhizomatiks Research × ELEVENPLAY「border」(2015年 VR音響システム)

攻殻機動隊 新劇場版 Virtual Reality Diver(2016年 バイノーラルミックス)

ホー・ツーニェン「ヴォイス・オブ・ヴォイド—虚無の声」(2021年 VR音響システム)

デモ

動画は開発中のものです。ヘッドフォンでご視聴ください。